Der Ansatz von NEXIS zur Governance von KI-Agenten gibt mehr preis als eine Produktbeschreibung. Er zeigt, wie weit die Branche beim Thema Agentic AI Governance bereits gedacht hat – und wo die wirklich schwierigen Fragen noch warten.

Wer sich mit der Governance von KI-Agenten beschäftigt, stößt früher oder später auf eine Frage, die technisch nicht beantwortbar ist: Nicht »Wie werden Agenten kontrolliert?«, sondern »Nach welchen Regeln operieren sie – und wer hat das Recht, diese Regeln zu setzen?« Das ist keine philosophische Spitzfindigkeit. Es ist die institutionelle Kernfrage, die hinter jedem ernsthaften Gespräch über Agentic AI steht.

Der Ansatz von NEXIS[1]Interview mit Dr. Heiko Klarl, CEO von NEXIS – positioniert als Identity Visibility and Intelligence Platform (IVIP) und Governance-Schicht oberhalb bestehender IAM-Systeme – bietet eine seltene Gelegenheit, diese Frage an einem konkreten Praxisfall zu schärfen. NEXIS gehört zu den wenigen Marktakteuren, die die konzeptuellen Herausforderungen mit erkennbarer Ernsthaftigkeit adressieren. Das verdient eine genaue Lektüre.

Drei Agententypen, ein Governance-Problem

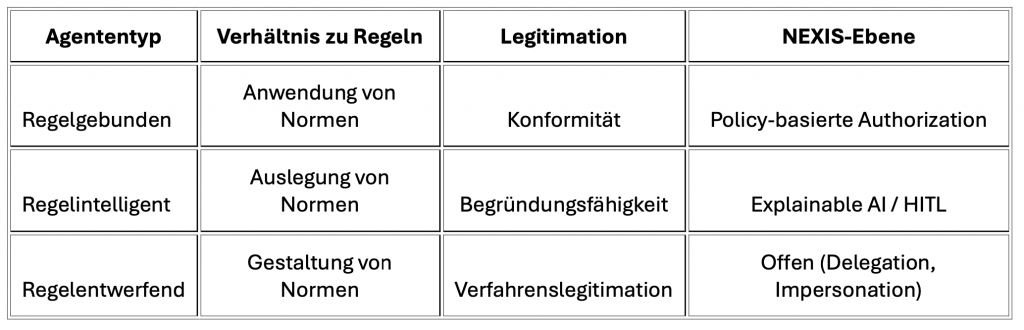

Um den NEXIS-Ansatz einzuordnen, ist eine kurze theoretische Vorverständigung hilfreich. In der Debatte über institutionell eingebettete KI-Agenten lassen sich drei Typen unterscheiden, die sich in ihrem Verhältnis zu Regeln fundamental unterscheiden.

Der regelgebundene Agent wendet vorgegebene Normen an, ohne sie zu interpretieren. Er ist zuverlässig, berechenbar und legitim – solange die Regeln, nach denen er operiert, selbst adäquat sind. Der regelintelligente Agent tut mehr: Er interpretiert Regeln, wägt Zwecke gegeneinander ab und handelt auch dort, wo Normen schweigen oder konkurrieren. Das erfordert Urteilsvermögen und erzeugt Begründungspflichten. Der regelentwerfende Agent schließlich gestaltet die Regelstruktur selbst – explizit durch Normentwürfe oder implizit durch Präzedenzfälle, die sich als Norm verstetigen.

Diese Unterscheidung ist kein akademisches Konstrukt. Sie hat unmittelbare Konsequenzen für die Frage, welche Governance-Strukturen ein Agentensystem benötigt – und welche Legitimationsbasis es voraussetzen muss.

Das Owner-Prinzip: Ein erster institutioneller Anker

Ein zentrales Governance-Postulat im NEXIS-Ansatz lautet: Jeder Agent muss einen Owner haben. Kein IT-Asset darf ownerlos sein. Jemand muss Verantwortung tragen, den Lifecycle managen und Policies zuweisen.

Das ist, institutionentheoretisch gesprochen, der Versuch, das Zurechnungsvakuum zu schließen, das KI-Agenten in klassischen Verantwortungsstrukturen hinterlassen. Denn ein Agent, der faktisch Entscheidungen trifft, aber keine soziale Adresse hat, an die Konsequenzen gerichtet werden können, ist ein Fremdkörper in jeder institutionellen Ordnung. Das Owner-Prinzip schafft diese Adresse.

Die Komplexität beginnt dort, wo sie strukturell unvermeidlich ist: Der Owner eines Agenten ist nicht notwendigerweise identisch mit dem Owner der Daten oder Applikationen, auf die der Agent zugreift. Ein Angebotsagent, der gleichzeitig auf CRM-Daten, SharePoint-Inhalte und eine Proposal-Software zugreift, hat faktisch mehrere unterschiedliche Data Owner, die jeweils explizit autorisieren müssen. Die übergeordnete regulatorische Verantwortung verbleibt beim Unternehmen – aber welche Funktion im Unternehmen, durch welche internen Strukturen, auf welcher Grundlage? Das bleibt, im NEXIS-Ansatz wie in der Branche insgesamt, noch offen.

Das Versprechen der Erklärbarkeit

Besonders bemerkenswert ist das NEXIS-Modell für Explainable AI: Jede Empfehlung des Systems wird mit einer nachvollziehbaren Begründung geliefert. Die KI schlägt vor, der Mensch entscheidet. Diese Kombination aus nachvollziehbarer Begründung und dokumentierter Entscheidung soll das Fundament für eine revisionssichere Nutzung schaffen.

Das ist in der Sprache der Governance-Theorie das Legitimitätsprofil des regelintelligenten Agenten: argumentative Rekonstruierbarkeit als Bedingung für institutionelle Akzeptanz. Der Ansatz verdient Respekt, denn er erkennt etwas an, das viele Anbieter im Markt noch umgehen: Erklärbarkeit ist nicht nur eine Usability-Anforderung, sondern eine governance-relevante Eigenschaft.

Ist eine gut aufbereitete Empfehlung auch wirklich eine Begründung? Begründen bedeutet, aus einer offenen Situation heraus mehrere Optionen zu erwägen und die beste mit Argumenten zu verteidigen, die für Kritik offenstehen. Rationalisieren bedeutet, eine bereits feststehende Selektion im Nachhinein argumentativ zu kleiden. Beide sehen von außen ähnlich aus.

Vertrauen in KI-Empfehlungen muss sich in der institutionellen Praxis bewähren – es lässt sich nicht assertieren.

Policies als Konditionalprogramme: Stark, aber nicht grenzenlos

Das technische Herzstück des NEXIS-Ansatzes ist die policy-basierte Authorization Governance. Statt statischer Rollenzuweisungen werden Zugriffsrechte dynamisch über Policies vergeben – die einzig skalierbare Antwort, wenn KI-Agenten menschliche Identitäten um den Faktor 50 bis 80 übersteigen.

In der institutionentheoretischen Begrifflichkeit sind Policies elaborierte Konditionalprogramme: flexibler als starre Rollenmodelle, aber strukturell immer noch auf das Wenn-Dann-Schema angewiesen. Die Stärke liegt in der Dynamik; die Grenze liegt dort, wo die Policy selbst inadäquat wird. Das eigentliche Risiko liegt nicht im Modell, sondern in der Pflege: Werden Policies nicht konsequent gewartet, entsteht das Problem. Das ist der klassische Fehlermodus des regelgebundenen Agenten – korrekte Ausführung einer inadäquaten Regel.

Aufschlussreich ist in diesem Kontext die Fähigkeit des NEXIS Identity Grid, historisch gewachsene Berechtigungslandschaften zu analysieren: Das System erkennt Rollen, die nie dokumentiert wurden, die aus früheren Rollen geerbt wurden, die als Ausnahme vergeben und nie bereinigt wurden. Das ist, funktional gesehen, die Sichtbarmachung von institutionellem Drift – die schleichende Verschiebung einer Governance-Struktur weg von ihrer ursprünglichen Intention, ohne dass dies je explizit entschieden wurde.

Wo die wirklich schwierigen Fragen stehen

Die aufschlussreichsten Leerstellen des NEXIS-Ansatzes liegen dort, wo die Branche insgesamt noch keine Antworten hat: Impersonation, Delegation und Agent-zu-Agent-Kommunikation sind nach eigenem Bekunden industrieweit noch ungeklärt.

Das sind präzis die Kontexte, in denen das Governance-Problem seinen eigentlichen Charakter zeigt. Impersonation – ein Agent handelt im Namen einer anderen Identität –, Delegation – ein Agent überträgt Aufgaben oder Berechtigungen an Subagenten –, und mehrstufige Agenteninteraktionen: Das sind alles Konstellationen, in denen klassische Konditionalprogramme strukturell überfordert sind. Nicht weil sie schlecht implementiert wären, sondern weil die entstehenden Situationen nicht mehr durch einfache Wenn-Dann-Logiken abgebildet werden können.

Wer in diesen Konstellationen handelt – auch wenn er formal nur »ausführt« –, entwirft faktisch neue Normen: durch Präzedenz, durch Architekturentscheidungen, durch die Art, wie Delegationspfade dokumentiert oder nicht dokumentiert werden. Das ist der regelentwerfende Bereich. Und für ihn fehlt, nicht nur bei NEXIS, sondern in der gesamten Branche, noch das institutionelle Äquivalent: ein Verfahren, das Regelentwurfsbefugnisse legitimiert, begrenzt und der Rechenschaftspflicht unterstellt.

Der NEXIS-Ansatz zeigt, wie weit der Praktikerdiskurs beim Thema Agentic AI Governance bereits gediehen ist. Die drei Ebenen des institutionell situierten Agenten sind darin empirisch erkennbar: die policy-basierte Authorization für den regelgebundenen Typus, das Human-in-the-Loop-Modell mit Explainability für den regelintelligenten Typus, und die explizit benannten offenen Fragen für den regelentwerfenden Bereich.

NEXIS entwickelt eine technische Governance-Infrastruktur, die für die ersten beiden Ebenen durchdachte Antworten bereithält. Für die dritte Ebene – die Legitimationsfrage der Normsetzung selbst – sind weder NEXIS noch die Branche insgesamt schon gerüstet. Das ist kein Versäumnis; es ist eine faire Beschreibung des aktuellen Stands.

Die Beobachtung, dass Agenten menschliche Identitäten um den Faktor 50 bis 80 übertreffen werden, beschreibt nicht nur ein Skalierungsproblem, sondern eine qualitative Verschiebung in der institutionellen Ordnung – eine, die durch technische Governance-Werkzeuge allein nicht eingeholt werden kann.

Die Frage, wer Regeln setzen darf, ist keine technische. Sie ist die älteste Frage institutioneller Ordnung – und sie stellt sich für KI-Agenten neu.

Ralf Keuper

References

| ↑1 | Interview mit Dr. Heiko Klarl, CEO von NEXIS |

|---|